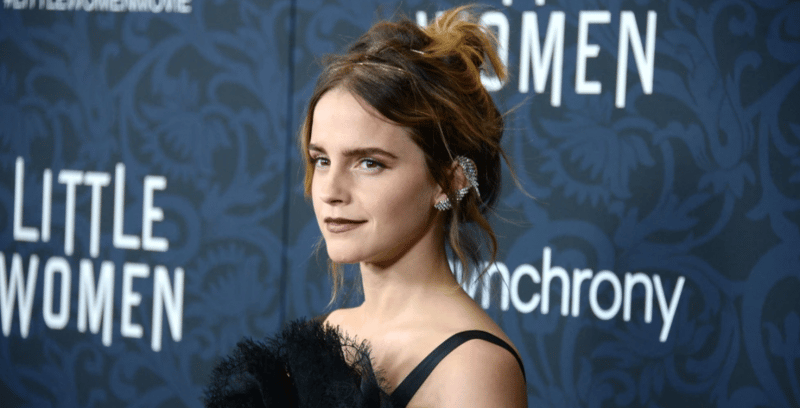

Membros de uma plataforma de mídia social usaram a voz de celebridades como a de Emma Watson e muitas vezes envolvendo comentários racistas ou abusivos

Um novo tipo de deepfake está se espalhando, baseado em gravações de voz. Por outro lado, os algoritmos biométricos de voz continuam a melhorar e os agentes de ameaças os estão usando para fraudes, roubo de identidade e outras atividades ilícitas.

Um artigo recente da Vice mostrou que vários membros da plataforma de mídia social 4chan usaram o software beta da ElevenLabs para gerar vozes que soam como celebridades, incluindo Joe Rogan, Ben Shapiro e Emma Watson. Muitas vezes as vozes são aplicadas fazendo comentários racistas ou abusivos.

A ElevenLabs fornece serviços de “síntese de fala” e “clonagem de voz”, supostamente para explorar novas fronteiras da IA de voz e ajudar “criadores e editores que buscam as melhores ferramentas para contar histórias”.

Nas asas está o Vall-e da OpenAI. De acordo com o TechCrunch , o modelo fez avanços substanciais nos últimos meses e agora é capaz de gerar deepfakes convincentes.

Quer saber mais obre isso? Digite My Own Voice, software de “banco de voz” com tecnologia AI do Acapela Group, uma startup francesa. Apresentado na CES 2023 e descoberto pela DigitalTrends , My Own Voice foi projetado para ajudar as pessoas que estão perdendo a capacidade de falar a recriar sua voz.

O software pode criar uma voz convincente usando apenas três minutos de áudio gravado.

Como lidar com deepfakes de voz com biometria

No entanto, medidas anti-spoofing também estão sendo desenvolvidas.

De acordo com os engenheiros de reconhecimento de voz da Pindrop, os call centers podem tomar medidas para mitigar os danos dos deepfakes de voz.

As empresas podem educar os trabalhadores sobre o perigo.

As funções de retorno de chamada podem encerrar chamadas suspeitas e solicitar uma chamada de saída ao proprietário da conta para confirmação direta.

Por fim, a autenticação multifator (MFA) e as soluções antifraude podem reduzir os riscos de deepfake. Pindrop menciona fatores como a criação de metadados de chamada para verificação de identidade, análise de tom digital e análise de pressionamento de tecla para biometria comportamental.

Até a China está trabalhando na regulamentação do deepfake. Conforme relatado pelo New York Times, o país revelou regras rígidas exigindo que o material manipulado tenha o consentimento do sujeito e tenha assinaturas digitais ou marcas d’água.

Não se sabe se os regulamentos funcionam com deepfakes. No entanto, os defensores dos direitos alertam que podem restringir ainda mais o discurso na China.

Fonte: Biometricupdate

Entrevistamos Sarra Ghaïb da HID sobre o uso da biometria nos setores: público, saúde e varejo

Cartão de Pagamento por Voz da Thales Gemalto traz inclusão, autonomia e comodidade

Reconhecimento biométrico de voz – tudo o que você deve saber

Biometria da voz é a nova solução contra fraudes na abertura de contas via WhatsApp

Inteligência artificial imitando vozes: quais os perigos desta tecnologia?

10 mitos e verdades sobre biometria de voz

Como o reconhecimento facial, impressões digitais, biometria por íris e por voz e além da biometria comportamental estão sendo utilizados para garantir a identificação digital precisa para mitigar fraudes e proporcionar aos usuários conforto, mobilidade e confiança.

Leia os artigos de nossa coluna de Biometria!

Inteligência Editorial que Orienta Cenários

Desde 2014, o Crypto ID oferece conteúdo editorial sobre tecnologia de segurança referente à requisitos técnicos e regulatórios. Levamos conhecimento e provocamos reflexões que sustentam decisões em transformação digital e cibersegurança. Temos a força do contexto que impulsiona a comunicação. Fale com a gente contato@cryptoid.com.br